Akademische Experten zerlegen Überwachungspläne der EU

Von Erich Moechel

In einer gemeinsamen Untersuchung, die am Freitag veröffentlicht wurde, hat etwa ein Dutzend akademischer Kryptographen die Überwachungsvorhaben von EU-Kommission und Ministerrat regelrecht auseinandergenommen. Das Vorhaben, Verbrechen im Netz durch automatische Scans aller Inhalte und den Einsatz „Künstlicher Intelligenz“ zu bekämpfen, sei „illusorisch“, so die Schlussfolgerung.

Sicher sei nur, dass die geplanten Maßnahmen einen Gutteil der bestehenden Sicherheitsmaßnahmen aushebeln würden. Damit würden nicht nur Einfallstore für Kriminelle und Geheimdienste geschaffen, sondern ein regelrechtes Polizeistaatsregime, so die Experten. Eine diesbezügliche EU-Verordnung wurde von Kommissarin Ylva Johansson für Anfang Dezember angekündigt.

Public Domain

Die Untersuchung trägt den Titel Wanzen in unseren Taschen, die Liste der Mitwirkenden liest sich wie ein globales Who’s Who der akademischen Kryptographie. Von Whitfield Diffie und Ronald Rivest, den Pionieren dieser mathematischen Zunft in den achtziger Jahren angefangen, sind fast alle illustren Namen vertreten. Eine Hauptrolle bei der Erstellung des Dokuments spielte Ross Anderson, Professor in Cambridge und Edinburgh und Autor des Standardwerks Security Engineering, das gerade in dritter Auflage erschienen ist.

Anfang Oktober fand eine längere Aussprache der EU-Innenminister zum Thema statt, über deren Inhalt und Verlauf danach absolut nichts bekanntgegeben wurde.

Die Datenbanken des Grauens

Untersucht wurden alle technisch denkbaren Methoden und deren Varianten, um vor allem inkriminiertes Bildmaterial schon vor oder während des Uploads zu entdecken und in Folge die Verbreitung dieser Inhalte zu verhindern. Vermeintliche Treffer sollten vielmehr automatisch an die Strafverfolger zur Beurteilung übermittelt werden. An einem solchen Automatismus hatten sich bereits Facebook und in Folge Apple versucht, diese Tests aber ziemlich schnell wieder eingestellt.

Facebook hatte Bilder und Videos nach dem Upload auf seinen Servern gescannt und mit einem sogenannten „Hash“ versehen, einer Quersumme aus der Bildinformation, wobei die Summe nach bestimmten Regeln gebildet wird. Diese Regeln gibt ein Algorithmus vor, der mit einer Datenbank abgeglichen wird. Diese Datenbank enthält ebensolche, nach derselben Regel von Bildern erstellte Hashes, im konkreten Fall solche mit Bildmaterial von Kindesmissbrauch, das in Strafgesetzbüchern immer noch als „Kinderpornographie“ gelistet wird. Die US-Kinderschutzbehörde NCMEC und andere unterhalten solche laufend weiter aufgefüllte Datenbanken des Grauens mit all dem Material, das rund um dieses Delikt bekanntgeworden worden ist.

Public Domain

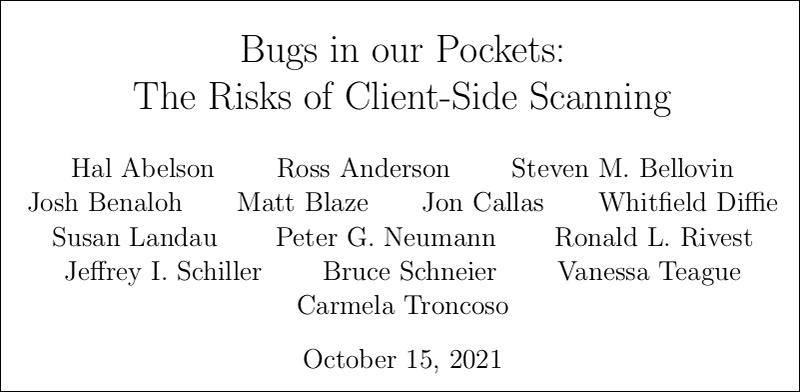

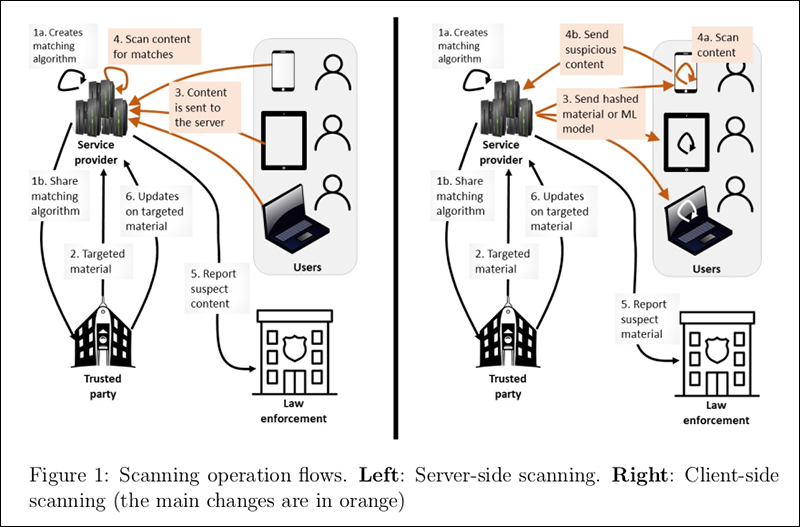

Diese Grafik aus der Untersuchung zeigt die beiden Ansätze. Sie unterscheiden sich im Wesentlichen nur in einem Punkt: Im ersten Fall (links) wird der Inhalt von Bildern auf dem Server durchgescannt, im zweiten Fall (rechts) findet der Scan noch auf dem Endgerät des Benutzers statt. In beiden Fällen ist die Trusted Party, mit der abgeglichen wird, eine der Datenbanken des Grauens, im Falle Europas wohl die einschlägige Datenbank von Interpol.

Wie Johansson Kindesmissbrauch als Hebel benutzen will, um E2E-Verschlüsselung von WhatsApp, Signal und Co auszuhebeln

Die sogenannte „Künstliche Intelligenz“

Apple hatte im Wesentlichen dasselbe, allerdings mit einem anderen Ansatz versucht, nämlich alle Bilder direkt auf dem Smartphone oder Tablet quasi vorbeugend mit Hashes zu versehen, die beim Upload dann mit einer Datenbank des Grauens abgeglichen wurden. Erst wenn zumindest 30 solcher „Treffer“ auf einem Endgerät zu verzeichnen waren, sollten die Bilder durch einen Automatismus erstmals an die Strafverfolger übermittelt werden. Das zeigt, wie wenig Apple selbst von der Zielgenauigkeit dieser Maßnahme hielt.

Auch Facebook hatte seinen freiwilligen Feldversuch bald abgebrochen, nicht etwa, weil es zu der Zeit nach EU-Recht (noch) illegal war, sondern weil es serienweise falsche Treffer gab. Falls die europäischen Institutionen, wie es Kommissarin Johansson angekündigt hatte, diese Durchscan-Pflicht auch auf Textchats erweitern, um Anbahnungsversuche von einschlägig interessierten Erwachsenen bei Kindern zu verhindern, dann würden die falschen Treffer überhaupt durch die Decke gehen , warnen die Wissenschaftler in ihrer Untersuchung. All diese Technologien werden übrigens unter dem Begriff „Künstliche Intelligenz“ subsummiert.

Public Domain

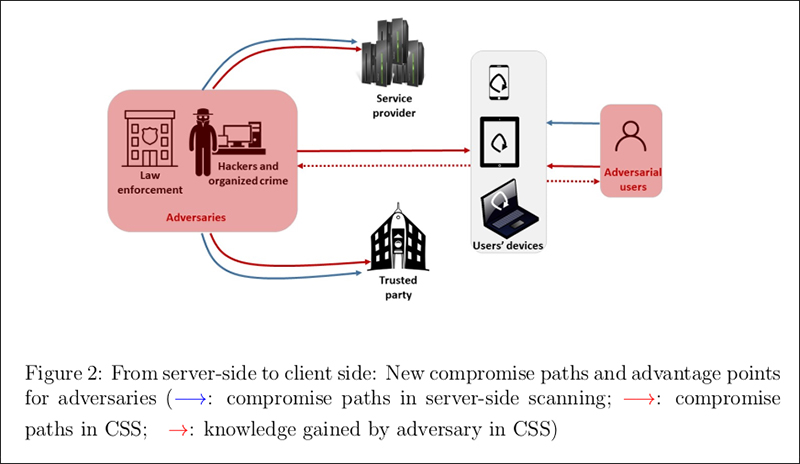

„Hacker und organisiertes Verbrechen“ bräuchten nur den neuen Datenbewegungen zu folgen, um Angriffspunkte gegen beliebige Kommunikationen zu identifizieren.

Im Juli 2020 hatte die Kommissarin versucht, durch verpflichtende Upload-Filter den Einsatz von E2E-Verschlüsselung unmöglich zu machen. Das Echo in der Fachwelt fiel nicht eben gnädig aus.

„Rote Linie überschritten“

„Das bringt uns an einen entscheidenden Punkt. Dieser Ansatz, vorbeugend alle Endgeräte der Benutzer nach bestimmten Informationen zu durchsuchen, ist weitaus heimtückischer als alle früheren Ansätze wie etwa Schlüsselhinterlegung“, heißt es abschließend. Anstatt gezielter Vorgangsweisen wie etwa die Überwachung eines einzelnen Telefons oder dessen forensische Untersuchung träten nun Massen-Scans aller privaten Daten, rund um die Uhr, ohne einen konkreten Verdacht und ohne einen richterlichen Durchsuchungsbefehl. Damit werde eine rote Linie überschritten.

Die Konsequenzen eines solchen Systems, sobald es einmal etabliert ist, liegen auf der Hand. Die geschilderten Methoden, nämlich alle Bild- oder Videoinhalte mit Hashes eindeutig zu kennzeichnen und damit automatisch filterbar zu machen, sind universell anwendbar. Damit würde für autoritäre Regimes ein mächtiges Instrument geschaffen, um in ihrem Machtbereich unerwünschte Inhalte gar nicht erst ins Internet gelangen zu lassen. Ein Staat wie Weißrussland müsste dafür nur eine eigene Datenbank erstellen, mit der jene Internetkonzerne abgleichen müssen, die ihre Services in Weißrussland anbieten wollen.

Der RSS-Feed zu diesem Blog. Sachdienliche Informationen, Metakritiken et al. sind über dieses Formular verschlüsselt und anonym beim Autor einzuwerfen. Wer eine Antwort will, gebe tunlichst eine Kontaktmöglichkeit an.

Publiziert am 17.10.2021